Tesla met en pause des modèles de voitures pour financer Optimus. Des startups annoncent des robots majordomes livrés l’an prochain. Et pourtant, quand on pose la question directement aux scientifiques qui ont construit les deux humanoïdes les plus avancés du monde, la réponse est plus sobre qu’attendu.

Jonathan Hurst, fondateur d’Agility Robotics, créateur de Digit : « Pas de façon fiable. » Scott Kuindersma, qui vient de quitter Boston Dynamics après des années à travailler sur Atlas : « Je ne pense pas que ce soit totalement résolu. » La question portait sur les escaliers et les portes. Nous sommes en 2026.

Trois révolutions en dix ans

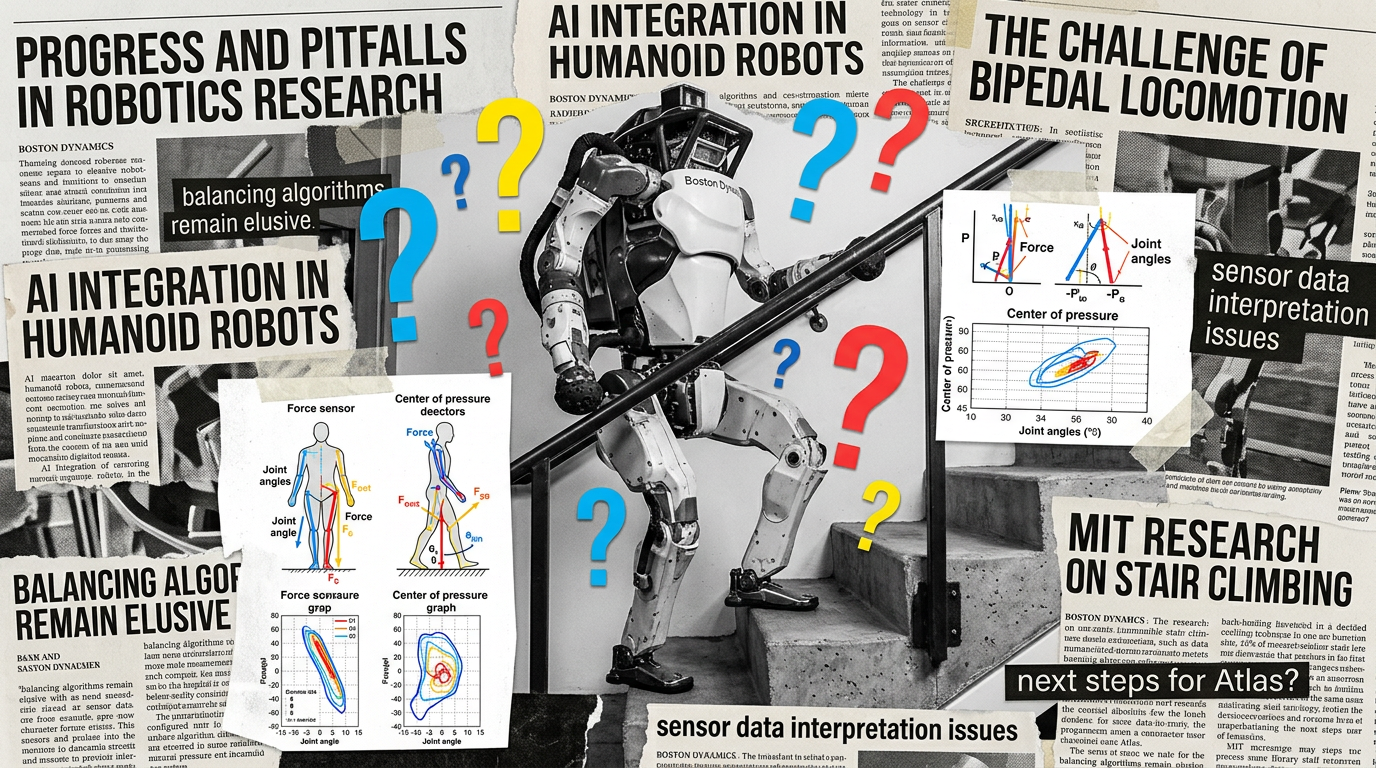

Quanta Magazine vient de publier une enquête fouillée sur l’état réel de la robotique humanoïde. Le tableau qui en ressort est beaucoup plus nuancé que les annonces marketing ne le laissent entendre. Mais le secteur a quand même connu trois sauts technologiques majeurs depuis 2015.

Premier saut : le deep learning et le reinforcement learning, qui ont transformé la locomotion et la perception. Les chercheurs entraînent désormais des « whole-body controllers », des contrôleurs de corps entier, via des millions de simulations numériques, sans modéliser manuellement chaque articulation. « Tout ce travail d’équations physiques, c’est terminé », dit Kuindersma.

Deuxième saut : les actionneurs proprioceptifs, des moteurs électriques compliants qui donnent aux robots une souplesse proche du vivant. Sangbae Kim, du MIT, a été le pionnier de cette approche avec ses robots Cheetah à partir de 2016. Sa conclusion est directe : « Le reinforcement learning existait avant. Mais avec les anciens moteurs, le robot cassait à chaque fois qu’il ratait. Le hardware a été le facteur activant. »

Troisième saut : les modèles vision-langage-action, ou VLA, introduits par Google DeepMind en 2023. Ces modèles, adaptés des grands modèles de langage, permettent aux robots de comprendre des instructions en langue naturelle et de les convertir en séquences de mouvements. Carolina Parada, directrice de la robotique chez DeepMind, illustre : « Si vous dites ‘j’ai soif’, le robot sait que vous voulez probablement boire, et génère les étapes pour trouver un objet et le saisir. Avant il y a trois ans, il aurait fallu coder ça à la main. »

Le verrou suivant : la perception des forces de contact

Alors, où ça coince encore ? Le verrou identifié par les chercheurs est la perception des forces de contact avec l’environnement. Un humain qui descend un escalier ajuste en permanence la pression sur chaque marche, détecte si le sol est glissant, compense un angle inattendu. Ces retours proprioceptifs fins, les robots n’en ont pas encore une maîtrise fiable.

Les escaliers « quelconques », pas une configuration précise apprise en simulation, restent un défi. Ouvrir n’importe quelle porte, pas une porte calibrée en laboratoire, pareil. Le fossé entre « ça marche dans un environnement contrôlé » et « ça marche partout » est encore large.

Notre analyse

Ce qui ressort de cette enquête, c’est un secteur qui a fait des progrès spectaculaires sur la locomotion, la planification et l’interaction en langage naturel, mais qui bute encore sur la physique brute du monde réel. Le mur n’est pas conceptuel : c’est l’ingénierie des capteurs de contact, la généralisation hors simulation, la robustesse dans des espaces non contrôlés.

Cela ne disqualifie pas les robots qui opèrent dans des environnements partiellement structurés : usines, entrepôts, couloirs. Mais pour le robot domestique universel vendu aux consommateurs, la fenêtre est ouverte, pas encore franchie. 2026, c’est l’année du prototype convaincant. L’année du produit fiable dans votre salon, c’est une autre question.