L’agent IA open source OpenClaw franchit une nouvelle étape : il est désormais capable de comprendre l’espace physique et la temporalité. Une démonstration impressionnante vient d’être partagée sur X, montrant OpenClaw aux commandes d’un robot humanoïde Unitree G1.

La démonstration en vidéo

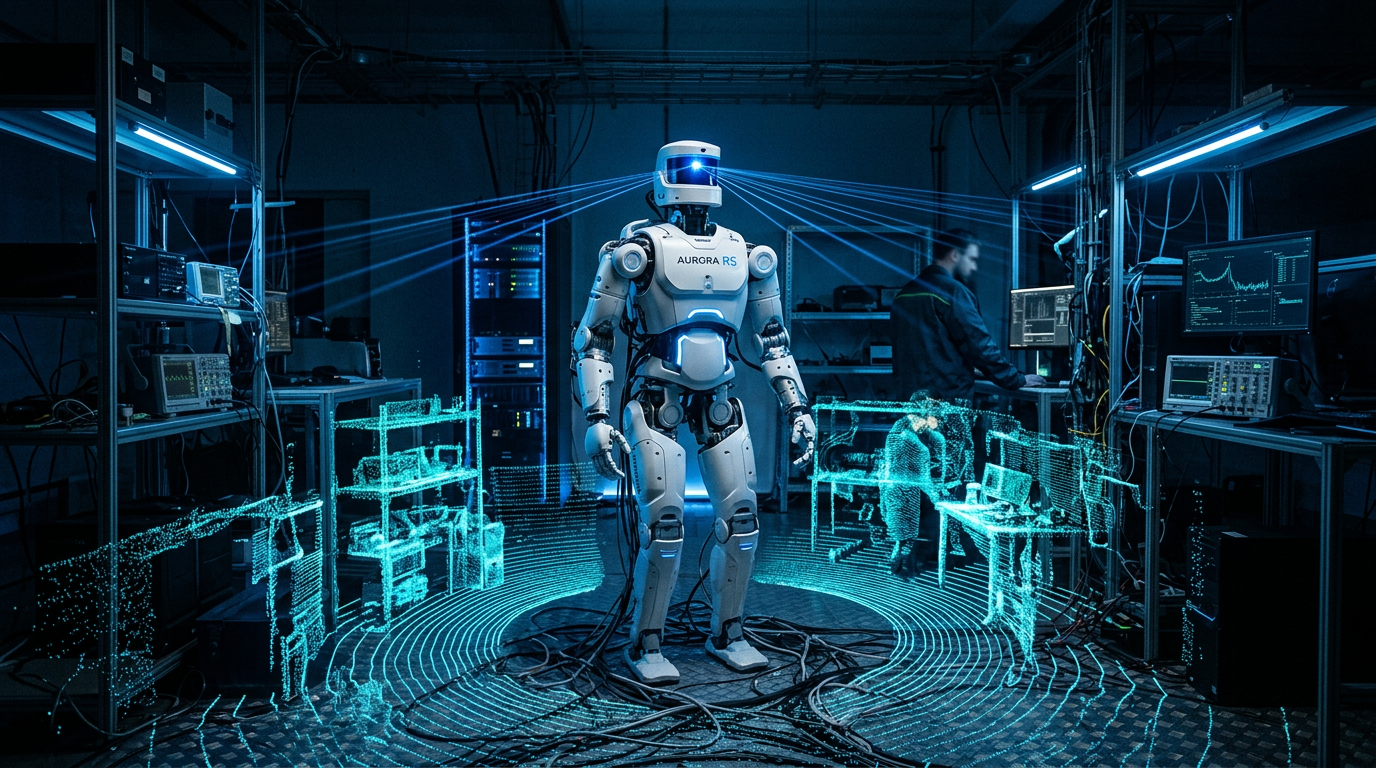

La vidéo montre l’interface complète du système : à gauche, un terminal où l’agent IA dialogue avec le robot via des commandes de navigation ; au centre, une visualisation 3D en nuage de points avec détection d’objets en temps réel (chaises, personnes, écrans) ; à droite, les flux caméra du robot. En bas, les données de télémétrie ROS avec les timelines de détection.

De l’assistant virtuel au robot physique

OpenClaw, créé par Peter Steinberger fin 2025, s’est imposé comme l’un des agents IA open source les plus populaires au monde, avec plus de 247 000 étoiles sur GitHub. Initialement conçu comme un assistant personnel autonome communiquant via Telegram, Signal ou Discord, le projet prend aujourd’hui une dimension physique.

Dans cette démonstration publiée par le développeur @stash_pomichter, on découvre OpenClaw intégré à un Unitree G1, capable d’interpréter les données de capteurs LiDAR, de caméras stéréo et de caméras RGB pour naviguer et interagir avec son environnement. Le tout en restant 100 % open source.

Openclaw can now understand physical space and temporality. Integrate with any lidar, stereo, rgb camera. Fully open source. Video below is our openclaw on a Unitree G1 humanoid. We integrate with most drones, quadrupeds as well.

@stash_pomichter sur X

Qu’est-ce qu’OpenClaw ?

OpenClaw (anciennement Clawdbot, puis Moltbot) est un agent IA autonome distribué sous licence MIT. Contrairement aux chatbots classiques qui se contentent de répondre à des questions, OpenClaw est un framework agentique qui exécute des tâches concrètes : il peut envoyer des emails, gérer un calendrier, contrôler des fichiers, automatiser des workflows et désormais piloter des robots.

Le logiciel, écrit en TypeScript et Swift, fonctionne en local et s’interface avec les grands modèles de langage (Claude, GPT, DeepSeek, Llama). Le projet a explosé en popularité début 2026, porté par la viralité de Moltbook. En février 2026, son créateur Peter Steinberger a annoncé rejoindre OpenAI, le projet étant transféré à une fondation open source pour garantir sa pérennité.

Le Unitree G1 : un humanoïde accessible

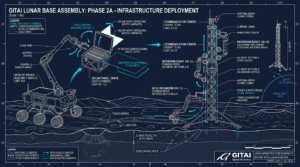

Le Unitree G1 est un robot humanoïde développé par le constructeur chinois Unitree Robotics, déjà connu pour ses robots quadrupèdes (Go2, B2). Lancé en 2024, le G1 se distingue par un positionnement tarifaire agressif : à partir de 21 600 dollars en version Basic, contre plusieurs centaines de milliers pour la concurrence.

Dans sa version EDU, le G1 embarque un processeur NVIDIA Jetson Orin (100 TOPS), une caméra Intel RealSense D435, un LiDAR LIVOX MID-360, et jusqu’à 43 degrés de liberté. Il supporte ROS 2, Python et C++, ce qui en fait une plateforme de choix pour la recherche en robotique. Des institutions comme Stanford, le MIT et Amazon l’ont déjà adopté, avec environ 5 000 unités livrées au premier semestre 2025.

Pourquoi c’est important

Cette intégration illustre une tendance forte : la convergence entre les agents IA logiciels et la robotique physique. OpenClaw ne se contente plus d’automatiser des tâches numériques, il peut désormais percevoir l’espace, comprendre la profondeur et la temporalité, et agir dans le monde réel.

Le développeur précise que l’intégration fonctionne aussi avec des drones et des robots quadrupèdes, ouvrant la voie à des applications variées : inspection industrielle, logistique, recherche ou encore assistance domestique. Le tout avec du matériel accessible et un logiciel entièrement ouvert.

Source : Tweet de @stash_pomichter | GitHub OpenClaw | Unitree G1