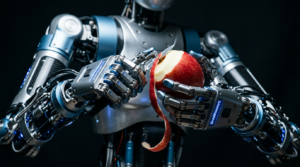

Éplucher une pomme semble anodin. Pour un robot, c’est l’un des tests les plus redoutables de la manipulation bimanuelle : une main doit faire tourner le fruit en maintenant une prise stable, pendant que l’autre guide un couteau avec une précision millimétrique. La pression doit varier a chaque instant pour ne pas percer la chair.

Cette semaine, Sharpa Robotics a publié une étude sur arXiv (2603.08122) détaillant comment son humanoïde SharpaNorth est parvenu a réaliser cette opération en autonomie complète. Une premiere dans le domaine de la robotique bimanuelle.

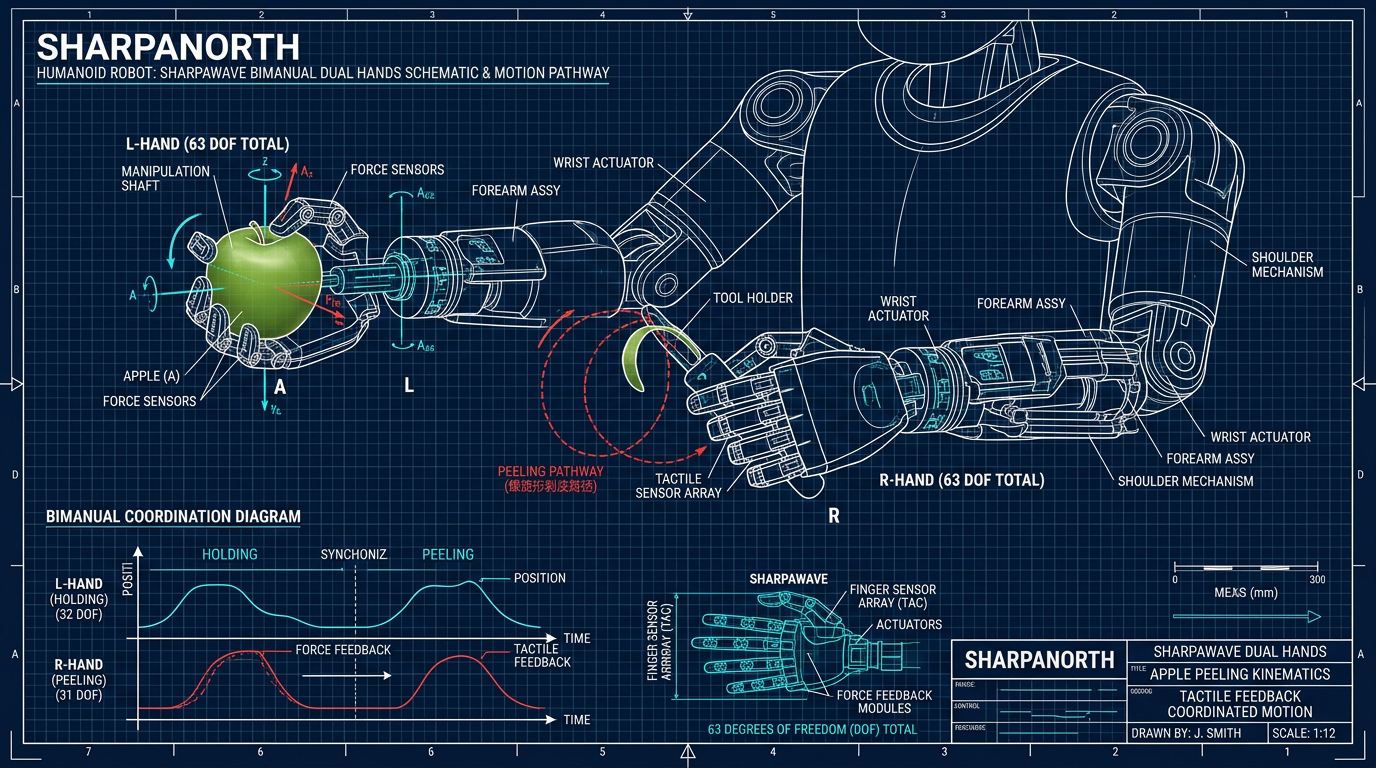

63 degrés de liberté, un goulot d’étranglement de données

Le SharpaNorth dispose de 63 degrés de liberté, répartis entre ses deux mains SharpaWave. Ces dernières utilisent des caméras internes pour détecter les déformations microscopiques du bout des doigts, une approche appelée « vision tactile ». Techniquement remarquable, mais le problème était ailleurs.

Le premier obstacle n’était pas mécanique mais cognitif : contrôler 63 degrés de liberté par télé-opération humaine est trop exigeant même pour un opérateur expert. Les données recueillies ainsi sont de mauvaise qualité pour l’entraînement d’un modèle IA.

IMCopilot : l’IA prend en charge les gestes fins

La solution de Sharpa s’appelle IMCopilot, pour In-hand Manipulation Copilot. Le principe : pendant la collecte de données, un humain porte un exosquelette et contrôle les mouvements grossiers du bras. Quand il actionne une pédale, l’IA prend automatiquement en charge les rotations fines de l’objet dans la main.

Ce mode d’autonomie partagée a permis de collecter des démonstrations de haute qualité qui auraient été impossibles en télé-opération traditionnelle. Un défi que l’industrie peine a résoudre depuis des années.

MoDE-VLA : des experts spécialisés par phase de tâche

Une fois les données collectées, l’architecture MoDE-VLA (Mixture-of-Dexterous-Experts VLA) entre en jeu. Les modèles VLA standards peinent a intégrer les retours de force et tactiles, qui ont des échelles temporelles differentes des données visuelles. Sharpa a résolu ce problème par deux mécanismes.

Le Sparse MoE Routing active des réseaux experts différents selon la phase de la tâche : approche, contact initial, rotation. Le Residual Injection injecte les corrections liées au toucher dans les mouvements sans effacer les connaissances générales du modèle.

Les chiffres du test

Sur quatre tâches contact-rich testées, MoDE-VLA améliore le taux de succès moyen de 34% par rapport au modèle de base. Sur l’épluchage de pomme, le taux passe de 0% a 30%. Mais le ratio de complétion atteint 73%, ce qui signifie que le robot réussit souvent a éplucher une grande partie de la pomme même quand il n’arrive pas au bout.

Sur l’assemblage d’engrenages, le taux grimpe de 40% a 60%. Sur l’enfichage de chargeurs, de 5% a 15%. Des marges encore limitées, mais la tendance est claire.

Sharpa présentera le SharpaNorth au GTC de NVIDIA, au stand 1838 en Hall 3. Le secteur cherche a déployer des humanoïdes dans des cuisines industrielles et des foyers : la capacité a manipuler des objets glissants et irréguliers reste l’un des derniers grands verrous techniques a faire sauter.