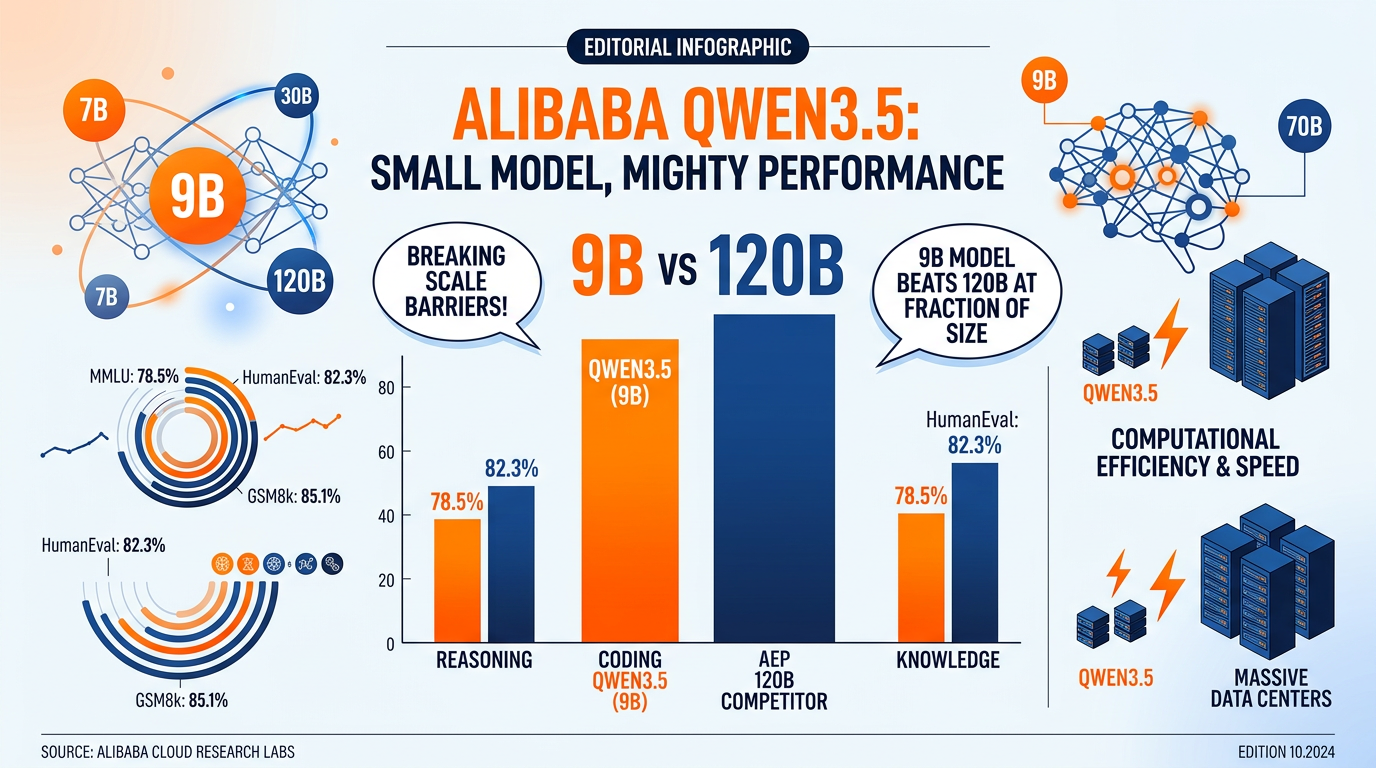

Alibaba vient de sortir quatre nouveaux modèles de langage compacts, regroupés sous le nom Qwen3.5 Small. La surprise : le plus grand de la série, avec 9 milliards de paramètres, surpasse le GPT-OSS-120B d’OpenAI sur plusieurs benchmarks clés. Ce dernier en compte 13 fois plus.

Quatre modèles pour quatre usages

La famille Qwen3.5 Small comprend les modèles 0.8B, 2B, 4B et 9B. Les deux plus petits (0.8B et 2B) sont conçus pour fonctionner sur des appareils mobiles ou embarqués, là où la batterie et la mémoire sont des contraintes strictes. Le modèle 4B cible les agents IA légers, avec une fenêtre de contexte de 262 000 tokens. Le 9B est le modèle de raisonnement le plus costaud de la série, capable de tourner sur un ordinateur portable standard.

Tous sont disponibles immédiatement sur Hugging Face et ModelScope, sous licence Apache 2.0. Cela signifie qu’ils peuvent être utilisés commercialement, modifiés et redistribués librement.

Des chiffres qui bousculent les idées reçues

Les résultats publiés par l’équipe Qwen parlent d’eux-mêmes. Sur le GPQA Diamond, qui mesure le raisonnement de niveau doctoral, le 9B obtient un score de 81,7 contre 80,1 pour le GPT-OSS-120B d’OpenAI. Sur le MMMU-Pro, benchmark de raisonnement visuel, il atteint 70,1 face au 59,7 de Gemini 2.5 Flash-Lite de Google. En compréhension vidéo, les scores sont respectivement 84,5 pour le 9B et 83,5 pour le 4B, contre 74,6 pour Flash-Lite.

Ces performances s’expliquent par une architecture repensee. Alibaba a combine des reseaux Gated Delta (une forme d’attention lineaire plus efficace en memoire) avec un melange d’experts parcimonieux. Résultat : moins de calculs pour de meilleures performances, un gain direct en latence et en cout d’inférence.

Le vrai changement : la multimodalité native

Ce qui distingue le plus ces nouveaux modèles de la génération précédente, c’est la façon dont ils traitent les images et les vidéos. Plutôt que d’ajouter un encodeur visuel sur un modèle texte existant, Alibaba a entraîné Qwen3.5 avec des tokens texte et image mélangés dès le départ. C’est ce qu’on appelle la fusion précoce.

Concrètement, le modèle 4B peut lire des éléments d’interface, compter des objets dans une vidéo ou analyser un document, des tâches qui nécessitaient jusqu’ici des modèles dix fois plus grands.

La Chine continue de comprimer l’écart avec les États-Unis sur les modèles open source. Après DeepSeek et ses variantes, Qwen3.5 Small confirme que la course à l’efficacité est bien engagée, et que les grandes tailles ne sont plus synonymes de meilleures performances.