Google DeepMind a lancé le 14 avril Gemini Robotics-ER 1.6, une mise à jour majeure de son modèle de raisonnement embarqué pour robots. Disponible dès aujourd’hui via l’API Gemini et Google AI Studio, ce modèle vise à combler le fossé entre l’intelligence numérique et l’action physique.

Un modèle qui raisonne sur l’espace, pas juste sur le texte

Gemini Robotics-ER 1.6 est conçu pour les tâches que les modèles classiques gèrent mal : comprendre la disposition d’une pièce, compter des objets, estimer des distances, détecter si une action a réussi ou non. En robotique, savoir qu’une tache est terminée est aussi crucial que savoir comment la commencer.

Le modèle prend en charge plusieurs flux vidéo simultanés (caméra embarquée, vue aérienne, caméra au poignet) et les combine pour former une compréhension cohérente de la scène. Il peut aussi appeler nativement des outils externes : Google Search pour trouver des informations, des modèles vision-langage-action (VLA) pour exécuter des mouvements, ou des fonctions tierces définies par les développeurs.

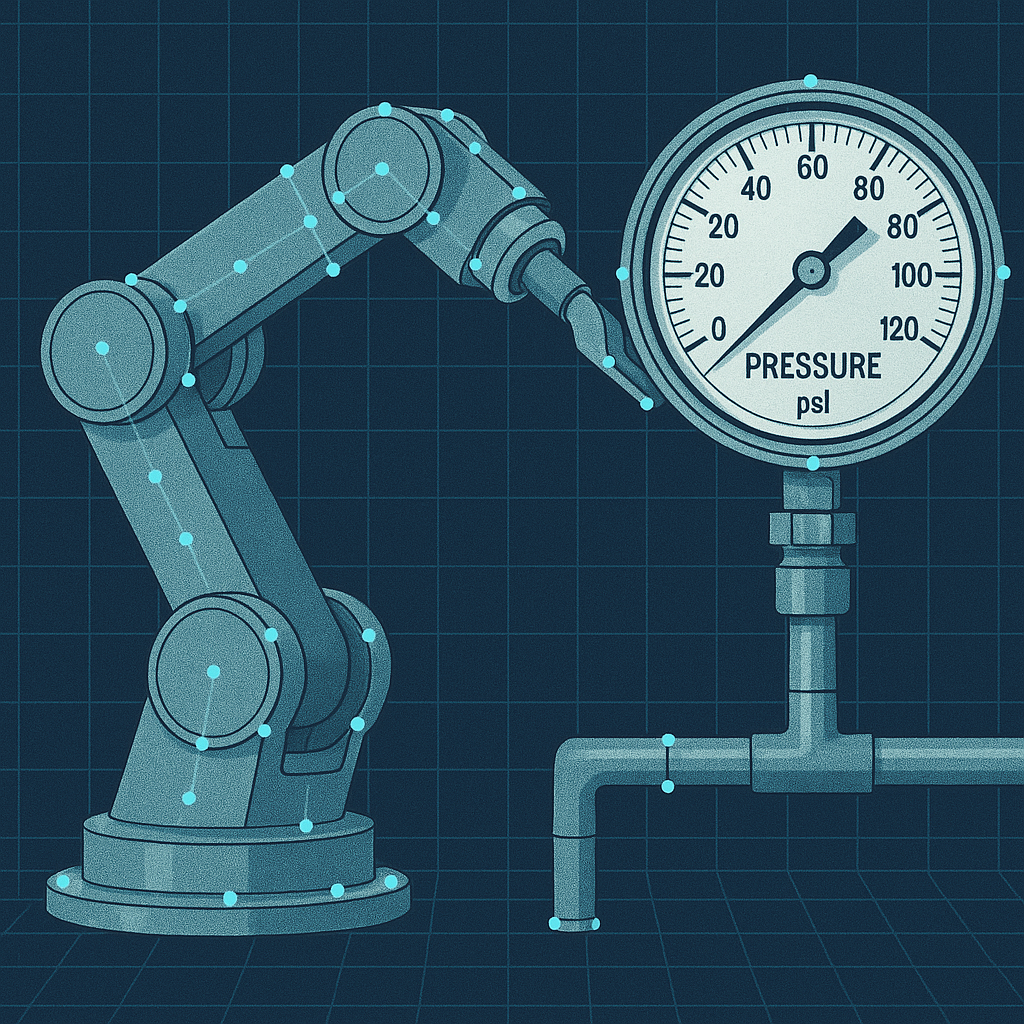

Lire une jauge industrielle : la nouvelle compétence venue de Boston Dynamics

Parmi les nouveautés, la lecture d’instruments industriels. Ce n’est pas un gadget : dans une usine ou une centrale, lire correctement un manomètre, une jauge de niveau ou un compteur est une tache quotidienne, souvent effectuée par un technicien faisant sa ronde. Gemini Robotics-ER 1.6 peut désormais interpréter ces affichages analogiques complexes avec une précision supérieure aux versions précédentes.

Cette capacité a été développée en collaboration avec Boston Dynamics, qui teste le modèle sur ses robots Spot pour les inspections de sites industriels. Le rapprochement entre Google DeepMind et Boston Dynamics (propriété de Hyundai) s’intensifie, chacun apportant son expertise : l’IA côté Google, le hardware côté Boston Dynamics.

Pointer, compter, détecter : les bases de l’autonomie

Le modèle excelle sur les taches de « pointing » (désignation d’objets), fondation de tout raisonnement spatial. Il peut identifier le nombre correct d’objets dans une scène, déterminer les relations spatiales entre eux (« l’objet le plus petit qui tient dans la tasse bleue »), et tracer des trajectoires de préhension optimales. Contrairement aux versions précédentes, il sait aussi ne pas pointer quand un objet n’est pas présent, ce qui réduit les hallucinations spatiales.

Côté sécurité, Google annonce que le modèle est le plus sûr de sa gamme robotique, avec une conformité renforcée aux politiques de sécurité sur les taches de raisonnement spatial adversarial.

Pourquoi c’est important

La course à l’IA physique ne se joue pas seulement sur le hardware. Le cerveau logiciel des robots est un marché à part entière, et Google y prend position avec un modèle accessible via API. Pour les centaines de startups robotiques qui développent des humanoïdes ou des bras industriels, disposer d’un modèle de raisonnement spatial performant et prêt à l’emploi change la donne. Plutôt que de former leur propre IA de A à Z, elles peuvent brancher Gemini Robotics-ER et se concentrer sur l’intégration physique.